Ethik ex machina. Ein digitales Experiment mit selbstfahrenden Autos

| Dauer | 1 Unterrichtseinheit |

| Schulstufe | ab der 12. Schulstufe |

| Methoden |

Gruppenpräsentationen |

| Material | Klassenraum mit Beamer, Zugang zu generativer KI, Laptops oder Tablets mit Internetzugang, Arbeitsblatt digital oder ausgedruckt |

| Kompetenzen | Ethik: Kompetenzbereich Argumentieren und Urteilen; Digitale Grundbildung: Kompetenzbereiche Orientierung und Handeln |

| Zielsetzungen | Die Schülerinnen und Schüler bewerten ein Szenario, in dem entschieden werden muss, wer von einem selbstfahrenden Auto überfahren wird (ähnlich dem "Trolley-Problem") – auf Basis ethisch-philosophischer Prinzipien. |

| Lehrplanbezug |

Ethik: 8. Klasse, Kompetenzmodul 7: Technik und Wissenschaft Digitale Grundbildung: 4. Klasse Kompetenzbereich Orientierung: die Grenzen und Möglichkeiten von Künstlicher Intelligenz reflektieren Anwendungsgebiet Mobilität (z.B. selbstfahrende Autos) |

| Autor | Lorenz Prager |

| Aktualisiert | 29.4.2025 |

|

|

Didaktische ÜberlegungenDas Lehr-Lern-Setting zielt darauf ab, eine konkrete – durch Digitalisierung bedingte – ethische Fragestellung (Wen soll das selbstfahrende Auto überfahren?) unter Rückgriff auf klassische ethisch-philosophische Konzepte zu beantworten. So soll die Brücke zwischen bestehenden ethischen Überlegungen, Theorien und Konzepten sowie neuen Fragestellungen geschlagen werden. Dabei werden die SchülerInnen zur Formulierung eines Werturteils in Bezug auf die Antwort der KI angeleitet. Da dieses Werturteil auf ihren subjektiven Norm- und Wertmaßstäben basiert, folgt diese Aktivität dem didaktischen Prinzip der Subjektorientierung. Dabei sollen die Vorstellungen, Normen, Werte und Lebenswelten der lernenden Subjekte in den Unterricht miteinbezogen oder überhaupt zu dessen Gegenstand werden. Der ethikdidaktische Grundsatz der Diskursorientierung wurde zur Planung dieses Lehr-Lern-Setting herangezogen. Dieses besagt, dass Probleme entweder diskursiv zu erarbeiten oder über die kritische Untersuchung vorgeschlagener Antworten zu erschließen seien. Genau das tun die SchülerInnen mit den Antworten der KI, die sich auf ethisch-philosophische Konzepte der jeweiligen Person beziehen. |

Ablaufbeschreibung

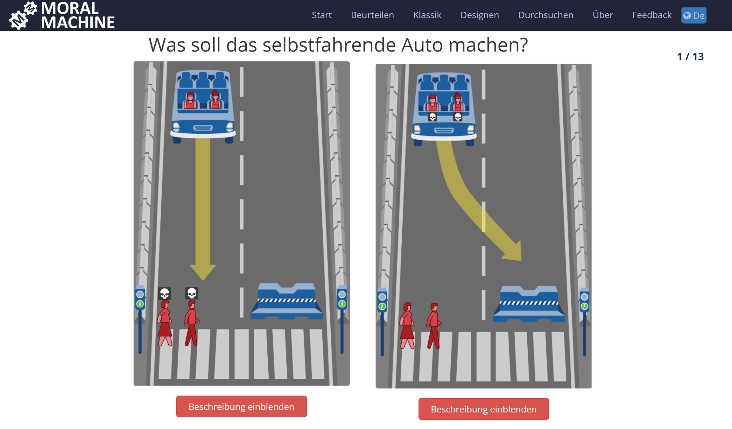

Schritt 1 Einstieg: Der Einstieg ist als aktivierender und provokanter Einstieg konzipiert. Öffnen Sie die Website moralmachine.net und klicken Sie auf “Beurteilung beginnen”. Projizieren Sie das Bild, erklären Sie die Situation und fordern Sie die Klasse auf, dazu Stellung zu beziehen. Dabei geht es nur um die Erhebung eines schnellen Stimmungsbilds, eine Minute Zeit für die Entscheidung ist ausreichend. Die SchülerInnen können ihre Entscheidung entweder mit Handzeichen oder indem sie sich auf eine Seite des Klassenraums begeben kundtun. Projizieren Sie weiter die Situation und halten Sie das Ergebnis schriftlich fest.

Abbildung 1: Beispielsituation von moralmachine.net

Abbildung 1: Beispielsituation von moralmachine.net

Schritt 2 Planungsphase: Besprechen Sie mit den SchülerInnen, dass sie sich in dieser Stunde mit ethischen Konzepten, die hinter solchen Entscheidungen stehen, beschäftigen werden. Sie werden sich mit den Positionen von berühmten PhilosophInnen beziehungsweise EthikerInnen beschäftigen und diese bewerten. Nämlich indem sie eine KI befragen, wie sich ihr/ihre KandidatIn entscheiden würde. Die Entscheidung muss mit philosophischen beziehungsweise ethischen Konzepten begründet werden. Fordern Sie die SchülerInnen auf, bei der KI nachzufragen, wenn sie etwas nicht kennen sowie eine Entscheidung für die Situation mit dem selbstfahrenden Auto einzufordern, falls die KI diese nicht bereitstellt.

Das Ergebnis der Recherche wird in Form einer kurzen Präsentation dargelegt, wobei ein/e GruppensprecherIn die Antwort der KI zusammenfasst. Danach wird das in der Gruppe formulierte Werturteil verkündet.

Schritt 3 Arbeitsphase: Teilen Sie das Arbeitsblatt aus und lassen Sie die SchülerInnen Gruppen (zu je zwei bis drei Personen) bilden. Mit Hilfe der Liste M1 können entweder Sie den SchülerInnen Philosophen bzw. Philosophinnen zuteilen oder die Lernenden auswählen lassen. Gehen Sie nun mit den SchülerInnen den epistemologischen Disclaimer auf dem Arbeitsblatt durch, damit klar wird, dass die KI nur eine auf Statistik beruhende Antwort auf Grundlage von Texten in den Trainingsdaten liefert. Beginn Sie jetzt die Arbeitsphase. Diese sollte etwa zehn Minuten dauern, damit genug Zeit für die Präsentationen bleibt.

Schritt 4 Präsentationsphase: Nach dem Ablauf der Arbeitszeit präsentieren die SchülerInnen die Antwort der KI: Erst wird die von der KI vorgeschlagene Entscheidung bekannt gegeben, dann die Begründung dafür. Abschließend äußern die SchülerInnen ihr Werturteil zu dieser Entscheidung. Falls es dazu Fragen aus der Klasse gibt, können diese am Ende der Präsentation gestellt werden.

Schritt 5 Abschluss: Falls noch Zeit übrig ist, fordern Sie die SchülerInnen erneut auf, Position zum Szenario zu beziehen. Fragen Sie, ob jemand seine Position verändert hat, und falls ja, weshalb.

Variante

Etwas mehr Abwechslung für den Preis von etwas weniger Strukturiertheit bietet die Variante, in der alle Gruppen ein unterschiedliches Szenario über die Website moralmachine.net bekommen. Dann muss zu Beginn der Präsentation das Szenario dargelegt werden, der Rest bleibt unverändert.